A Microsoft apresentou recentemente o GRIN-MoE (Gradient-Informed Mixture of Experts), um modelo open-source que promete revolucionar o campo da inteligência artificial. Com uma arquitetura eficiente e desempenho notável, o GRIN-MoE destaca-se especialmente em tarefas de codificação e matemática, superando modelos maiores em eficiência e precisão.

O que é o GRIN-MoE?

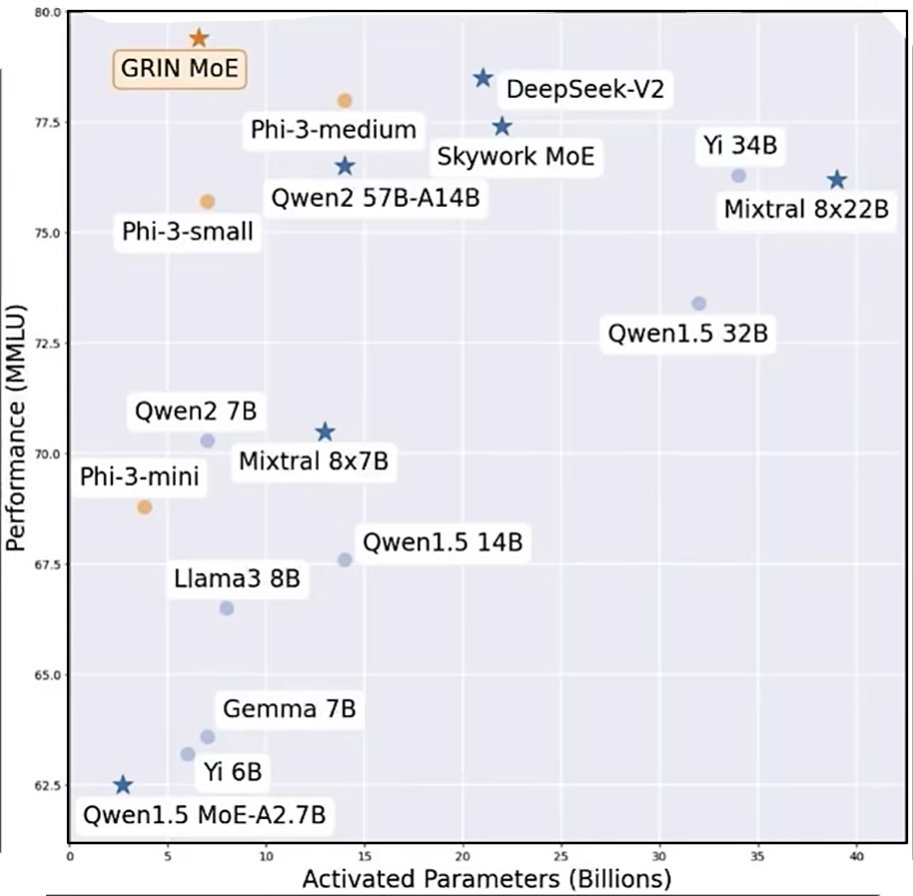

O GRIN-MoE é um modelo de Mistura de Especialistas (Mixture of Experts – MoE) que utiliza gradientes informados para otimizar a seleção de especialistas durante o processo de inferência. Com apenas 6,6 bilhões de parâmetros ativos, ele consegue alcançar resultados excepcionais, comparáveis a modelos muito maiores.

Desempenho Impressionante com Menos Recursos

Uma das principais vantagens do GRIN-MoE é sua capacidade de oferecer alto desempenho sem a necessidade de grandes quantidades de parâmetros ativos. Isso resulta em:

- Maior Eficiência Computacional: Consome menos recursos, permitindo implementações mais acessíveis e sustentáveis.

- Desempenho Superior em Codificação: Mostrou-se altamente eficaz em tarefas relacionadas à geração e compreensão de código.

Comparação com Outros Modelos

Em avaliações comparativas, o GRIN-MoE supera modelos como:

- DeepSpeed-Chat 2

- Mistral 7B

- Modelos da série GPT-3

Seu desempenho é atribuído à abordagem inovadora na seleção de especialistas, que otimiza o processo de inferência sem sobrecarregar os recursos computacionais.

Contribuição Open-Source

Ao disponibilizar o GRIN-MoE como open-source, a Microsoft fortalece a colaboração com a comunidade de IA, permitindo que pesquisadores e desenvolvedores:

- Personalizem e Melhorem o Modelo: Adaptando-o a diferentes necessidades e aplicações.

- Acelerem a Inovação: Facilitando a integração do modelo em novos projetos e soluções.

Impacto no Futuro da Inteligência Artificial

O GRIN-MoE representa um passo significativo em direção a modelos mais eficientes e especializados. Suas características indicam uma tendência de:

- Foco na Qualidade sobre a Quantidade: Mostrando que modelos menores podem igualar ou superar modelos maiores em desempenho.

- Sustentabilidade: Reduzindo a pegada de carbono associada ao treinamento e à execução de grandes modelos de IA.

- Acessibilidade: Democratizando o acesso a modelos de alta performance.

Conclusão

O GRIN-MoE da Microsoft é uma inovação notável no desenvolvimento de modelos de linguagem. Com sua eficiência e desempenho superiores, ele tem o potencial de influenciar significativamente a maneira como construímos e utilizamos modelos de IA no futuro. Este avanço ressalta a importância da pesquisa contínua e da colaboração open-source para impulsionar a tecnologia e beneficiar a sociedade como um todo.

Pesquisa, Curadoria, Edição, formatação e finalização:

Werney Lima, setembro 21, 2024 (Sábado) – 15:36 hrs.